DARMSTADT. Die Hochschule Darmstadt hat ein Forschungsprojekt vorgestellt, das eine Software zur automatischen Erkennung von „Haßrede“ im Internet entwickeln soll. „Die sozialen Medien wie Twitter, Facebook und auch die Kommentarspalten der Online-Präsenzen von Zeitungen und Radiosendern werden zunehmend von Menschen dominiert, die diffamieren, beleidigen und bedrohen“, teilten die Wissenschaftler am Montag mit.

Automatisch generierte Nachrichten würden im Netz verwendet, um den Eindruck einer Mehrheit zu erwecken, die bestimmte Meinungen vertrete. „Daher besteht ein dringender Bedarf an Methoden zur automatischen Identifizierung verdächtiger Beiträge.“

Die Wissenschaftler arbeiten bei ihrem „Detox – Detektion von Toxizität und Aggression in Postings und Kommentaren im Netz“ genannten Forschungsvorhaben sowohl mit der hessischen Meldestelle für sogenannte „Haßkriminalität“ „Hessen gegen Hetze“ zusammen, als auch mit dem Darmstädter Fraunhofer-Institut für Sichere Informationstechnologie.

Wissenschaftler: „Haßrede“ an vielen Emojis und Ausrufezeichen erkennbar

Als Grundlage für die Klassifizierung von „Haßrede“ dient den Forschern die Definition der Landesmeldestelle. „Haßrede“ im Internet bestünden vor allem in Postings, Kommentaren und Bildern, die Menschen aufgrund bestimmter Eigenschaften – wie zum Beispiel Hautfarbe, Geschlecht, Religionszugehörigkeit und Nationalität – angreifen.

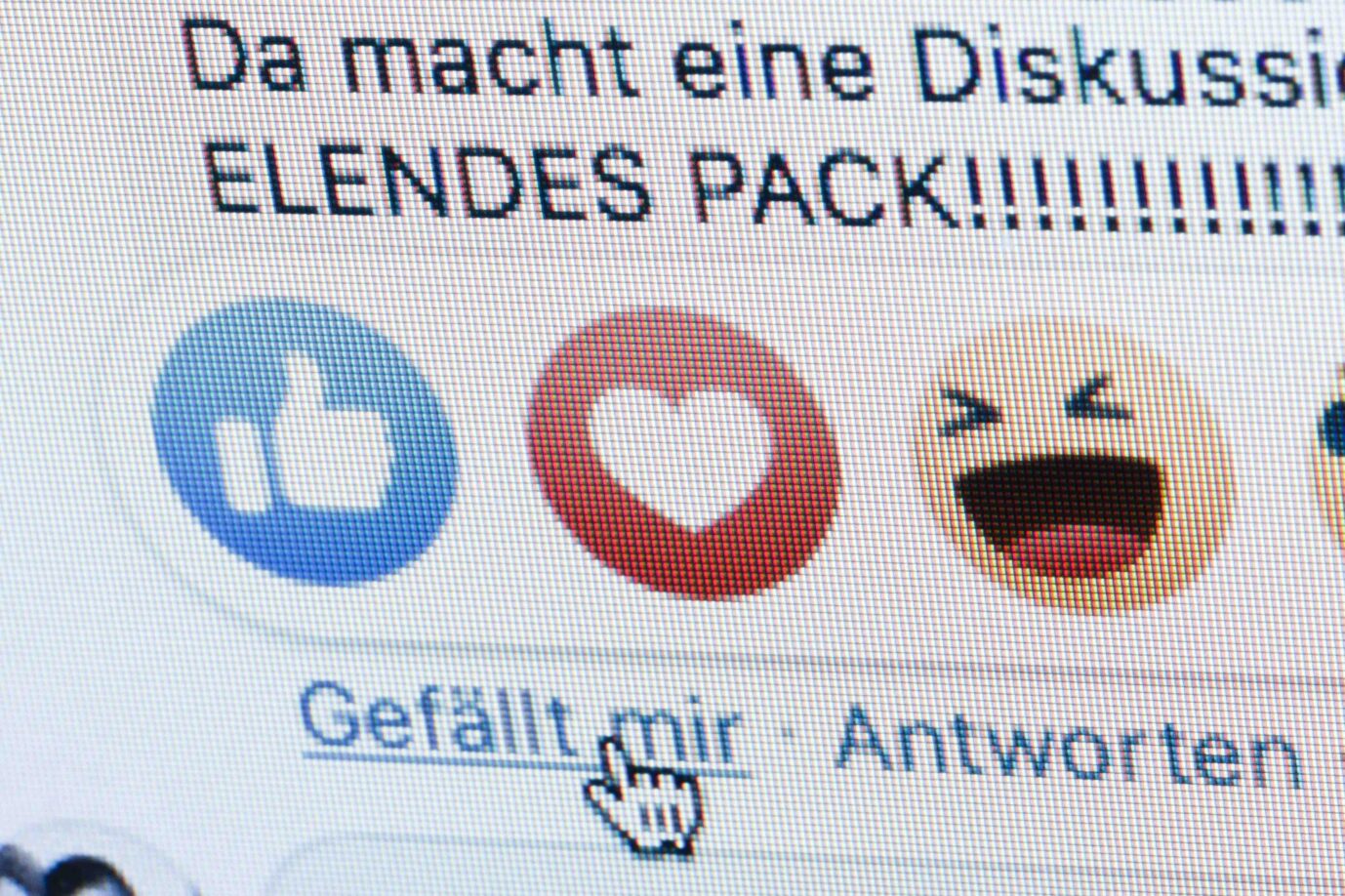

Im Laufe der Forschungsarbeiten seien die Wissenschaftler zu der Einsicht gelangt, daß „Haßrede“ und Falschinformationen besondere sprachliche Eigenschaften aufwiesen. Sie zeichneten sich durch viele Personalpronomen, Ausrufezeichen, Emojis und große Überschriften aus, unter denen dann nur wenig Text stünde.

„Detox“ befasse sich nicht allein mit der Erkennung „haßbezogener“ Beiträge, sondern auch mit deren automatischer Überführung in mögliche Straftatbestände. Die Grundrechte sieht die an dem Projekt beteiligte Informatikerin Melanie Siegel durch ihre Arbeit allerdings nicht gefährdet. „Die Meinungsfreiheit ist ein hohes Gut, daher würde ich die Filterung niemals komplett automatisiert Maschinen überlassen“, betonte die Wissenschaftlerin. (fw)