Herr Professor Srinivasan, droht die künstliche Intelligenz (KI) außer Kontrolle zu geraten?

Ramesh Srinivasan: Nein, keineswegs.

Warum haben Sie dann Ende März zusammen mit Größen wie Yuval Noah Harari, Steve Wozniak und anderen Elon Musks Forderung nach einem Moratorium für deren Entwicklung unterschrieben?

Srinivasan: Weil ich alles unterstütze, um die gegenwärtige Entwicklung einzudämmen oder zu pausieren. Und das ist nicht nur für die Entwicklung von KI nötig, sondern für alle Technologien, die die menschliche Kreativität und Kommunikation einzuebnen drohen. Denn das ist, was passieren wird, wenn Systeme wie ChatGPT-4 …

… das derzeit fortschrittlichste KI-Programm, das der allgemeinen Öffentlichkeit zur Verfügung steht …

Srinivasan: … so ungehindert wie bisher weiterentwickelt werden. Dann wird KI bestimmte Teile unseres Lebens übernehmen.

Aber genau dafür wird sie doch entwickelt.

Srinivasan: Sicher, aber wir müssen uns gut überlegen, welchen Hintergrund diese Dinge haben, zum Beispiel in ökonomischer Hinsicht.

„KI erst weiterentwickeln, wenn Risiken überschaubar sind“

Aber jeder kann sich ChatGPT-4 beim US-Hersteller OpenAI doch kostenlos herunterladen.

Srinivasan: Stimmt, allerdings folgt OpenAI, inklusive Verwendung der Sprache der Open-Source- Bewegung, damit nur einem der üblichen Wege des Silicon Valley, sich einen gemeinnützigen Anschein zu geben. Was aber leicht vergessen läßt, daß die digitale Ökonomie ihren Gewinn vor allem auf einem ganz anderen Feld macht, nämlich mit der Kommerzialisierung persönlicher Daten. Wofür sie das Internet benutzt, das aber nicht sie selbst, sondern die Bürger mit ihren Steuern bezahlen.

Und was folgern Sie daraus?

Srinivasan: Daß sich bezüglich der Ökonomie von morgen das Entstehen einer neuen strukturellen Ungleichheit auf globaler Ebene abzeichnet. Und das kann ein großes Problem für uns alle werden.

Und weil Sie darüber diskutieren wollen, haben Sie das Moratorium unterschrieben – da Sie denken, daß das die dafür nötige Aufmerksamkeit erzeugt. Habe ich das richtig verstanden?

Srinivasan: Es geht mir nicht darum, daß die Gesellschaft diskutiert, was ich will, sondern daß überhaupt über die Probleme diskutiert wird, die da auf uns zukommen. Und warum das Moratorium, fragen Sie?

Weil ich damit übereinstimme, „daß leistungsstarke KI-Systeme erst dann weiterentwickelt werden sollten, wenn wir sicher sind, daß ihre Auswirkungen positiv und ihre Risiken überschaubar sind“, und wir dafür „robuste KI-Governance-Systeme und neue und fähige Regulierungsbehörden“ benötigen, die uns zu einem neuen Wirtschaftsmodell führen.

Und zu diesem müssen wir die Unternehmen der IT-Branche drängen, da sie sonst zu einer globalen Digitalökonomie verwachsen werden.

„KI kann uns nur nachahmen“

Die Sorge, die in der populären Debatte über KI am meisten umzutreiben scheint – nämlich ob KI uns Menschen eines Tages stürzen und ersetzen könnte – haben Sie nicht erwähnt. Warum nicht?

Srinivasan: Weil das, mit Verlaub, völlig absurd ist.

Weshalb?

Srinivasan: Weil KI nicht im entferntesten in der Lage ist zu denken, sondern nur nachahmen kann.

Probiert man ChatGPT-4 aus, wirkt es allerdings, als ob man es mit einer eigenständigen Person zu tun hat, die zudem auch noch extrem schlau und fast allwissend ist. Eine ausgesprochen unheimliche Erfahrung.

Srinivasan: Und dennoch ist es eine Täuschung, denn dahinter ist nur ein System aus Algorithmen, das Muster erkennt und reproduziert. Doch warum ist es dazu in der Lage? Weil seinen Berechnungen die vielen Informationen über uns und unser Leben zur Verfügung stehen, mit denen wir bereitwillig, beständig und gratis das Internet füttern!

Im von Ihnen unterstützten Aufruf Elon Musks ist die Rede davon, daß die heutige KI „nicht einmal ihre Erfinder verstehen, vorhersagen oder zuverlässig kontrollieren“ können. Wieso sind Sie also so sicher, daß es uns eines Tages nicht ergeht wie Goethes Zauberlehrling?

Srinivasan: Verstehen Sie mich nicht falsch. Wenn Menschen solche Ängste hegen, will ich mich keineswegs darüber lustig machen. Aber das ist pure Science-Fiction, denn, völlig egal, wie gut Algorithmen eigenständiges Denken auch in Zukunft vortäuschen können und wie sehr uns das beeindrucken mag, mit Denken hat das nichts zu tun.

„Wissen nicht, was genau Intelligenz ausmacht“

Wenn es sich also gar nicht um Intelligenz handelt, warum heißt es dann so?

Srinivasan: Die Wahrheit ist, daß wir selbst nicht wissen, was genau Intelligenz ausmacht. Bisher haben wir nur einige ihrer Bestandteile erforscht, wie die Fähigkeit zur Mustererkennung, die wir nun Computern beibringen. Aber den menschlichen Geist zu entschlüsseln haben wir bis heute nicht vermocht.

Vielleicht sollten wir uns weniger Science-fiction-Filme ansehen und uns dafür mehr in unserer Realität umschauen. Ich weiß nicht genau, wie die Lage bei Ihnen in Deutschland ist, aber bei uns in den USA, und auch in Großbritannien, müssen selbst Absolventen meiner Universität, die mit zu den besten der Welt gehört, sich anschließend mit dem Fahren von Uber-Taxis durchschlagen. Und während die Inflation steigt, sinkt die Lebenserwartung der Menschen. Das sind die Probleme und Gefahren!

Aber was hat KI damit zu tun?

Srinivasan: Nehmen Sie Ihre Frage, ob KI uns eines Tages zu ersetzen droht: Ja, und nicht erst eines Tages, sondern schon heute! Doch nicht im Sinne von Hollywoodfilmen wie „Terminator“, in dem Maschinen die Menschheit ausrotten, sondern in dem Sinne, daß KI Aufgaben übernimmt, die bisher von Menschen erledigt werden, und diese arbeitslos macht.

Was für das soziale Gefüge unserer Gesellschaft, die sowieso schon vom Klimawandel bedroht ist, zur großen Gefahr wird. Wobei die Ursache dafür eigentlich nicht die Technologie ist – es also nicht darum geht, ob KI „böse“ oder „gut“, gefährlich oder ungefährlich ist. Der Punkt ist vielmehr: Was lassen wir zu? Wie setzen wir sie ein? Wer macht damit was? Und dahinter steht die Frage: Was macht unsere Gesellschaft und was macht uns als Menschen aus? Was bedeutet es, ein Lebewesen zu sein und mit anderen zusammenzuleben? Welche Bedürfnisse haben wir eigentlich?

Sie meinen, KI sollte uns ein Anlaß sein, uns wieder intensiver mit diesen ethischen Fragen zu beschäftigen?

Srinivasan: Das müssen wir sogar, und sollte ein Science-fiction-Film KI in dieser Weise behandeln, würde ich ihn sehr empfehlen! Nur leider ist das meist nicht der Fall, vielmehr beschleicht einen der Verdacht, es geht bei dem populären Thema, ob KI uns auslöschen könnte, nur darum, uns davon abzuhalten, diese eigentlichen Fragen zu stellen und uns selbst und die Verhältnisse zu hinterfragen.

Denn tatsächlich wird die zunehmend desolate Lage unserer Gesellschaft maßgeblich von einer Ökonomie mitverursacht, die unser Leben einer von privaten Megakonzernen vorangetriebenen massiven Technologisierung unterwirft. Denn noch vor zehn, fünfzehn Jahren dachten wir doch, mit unseren persönlichen Daten würden wir ein demokratisches Internet für jedermann erschaffen – inzwischen aber müssen wir erkennen, daß es vor allem zu einer Art Skinner-Box geworden ist.

„Daten sind fast jedem manipulativen System bekannt“

Sie spielen auf den berühmten US-Verhaltensforscher B. F. Skinner an und die nach ihm benannten Käfige, in denen er Versuchstieren standardisiert und automatisiert neue Verhaltensweisen beibrachte.

Srinivasan: Ja, denn unsere Daten speisen Algorithmen, die uns beeinflussen und manipulieren sollen, um unsere Aufmerksamkeit auf bestimmte Inhalte zu lenken, wovon vor allem die sozialen Medien leben. Und darüber hinaus müssen wir feststellen, daß dies nicht nur auf die Online-Welt beschränkt ist, sondern unsere dort preisgegebenen und gesammelten Daten inzwischen in beinahe jedem System verwendet werden, das Vorhersagen, Verhaltensanalysen und dem Beobachten und Beeinflussen von Menschen dient.

Wie zum Beispiel dem Mikrotargeting, einem Verfahren, die Gesellschaft in verschiedene Untergruppen einzuteilen, um Botschaften jeder Art möglichst spezifisch zuzuschneiden und damit noch effektiver in unsere Köpfe zu tragen. Deshalb ist es so ungeheuer wichtig, daß wir bei der Entwicklung von KI-Systemen und anderen Technologien mit solchem Einfluß pausieren, um Zeit zu haben, Regeln und Normen zu diskutieren und aufzustellen, die verhindern, daß ihre Anwendung auf Kosten unserer menschlichen Bedürfnisse geht.

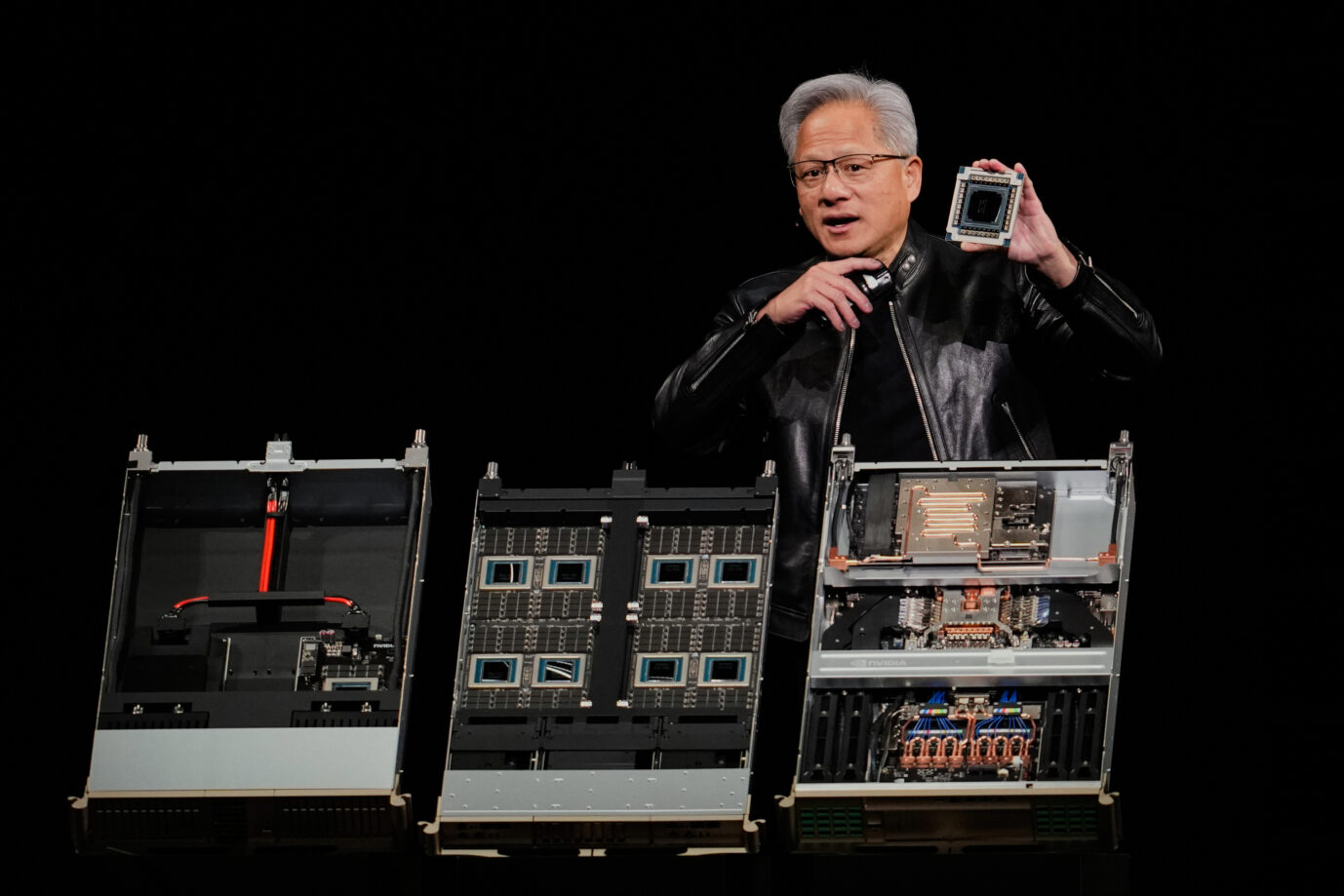

Dazu hat US-Präsident Biden nun die Chefs der bedeutendsten KI-Hersteller, wie Google, Microsoft oder Open AI, ins Weiße Haus bestellt und sie gebeten, Hacker auf die Systeme anzusetzen, um mögliche Gefahrenstellen zu entdecken, die einen Mißbrauch der KI jenseits gesellschaftlich gesetzter Grenzen ermöglichen könnte.

Srinivasan: Ja, doch selbst wenn es gelingen sollte, KI angemessen zu regulieren, sehe ich noch Gefahren, die schlicht aus ihrer Anwendung erwachsen.

„Wir verlieren den Sinn dafür, was es heißt, Mensch zu sein“

Zum Beispiel?

Srinivasan: Für viele mag es im ersten Moment vielleicht nicht bedrohlich klingen, doch was mich sehr besorgt, ist etwa, daß wir unseren Sinn für Geschichte verlieren könnten.

Inwiefern das?

Srinivasan: Wenn unsere Gesellschaft künftig von Maschinen geprägt wird, die lediglich massenkulturelle Muster reproduzieren, dann wird Geschichte zu Daten. Aber das, was Geschichte eigentlich lehrt, sind Erfahrungen. Die Gefahren für eine Gesellschaft, die ihren Sinn für Geschichte verliert, sind daher ebensogroß wie für uns Menschen, wenn wir angesichts der Technologisierung den Sinn dafür verlieren, was es bedeutet, ein Mensch zu sein.

In meinem Buch „Beyond the Valley“ zeige ich dagegen das Potential auf für eine digitale Gesellschaft der Zukunft, die Unternehmen ebenso unterstützt wie die Interessen von Arbeitnehmern und Bürgern und sie mit kultureller Vielfalt und sozialer Gerechtigkeit in Ausgleich bringt. Zum Beispiel indem die USA oder ein anderes Land vorangeht und das erste digitale Gesetzbuch der Welt verabschiedet, das dafür die Grundlage schaffen könnte.

__________

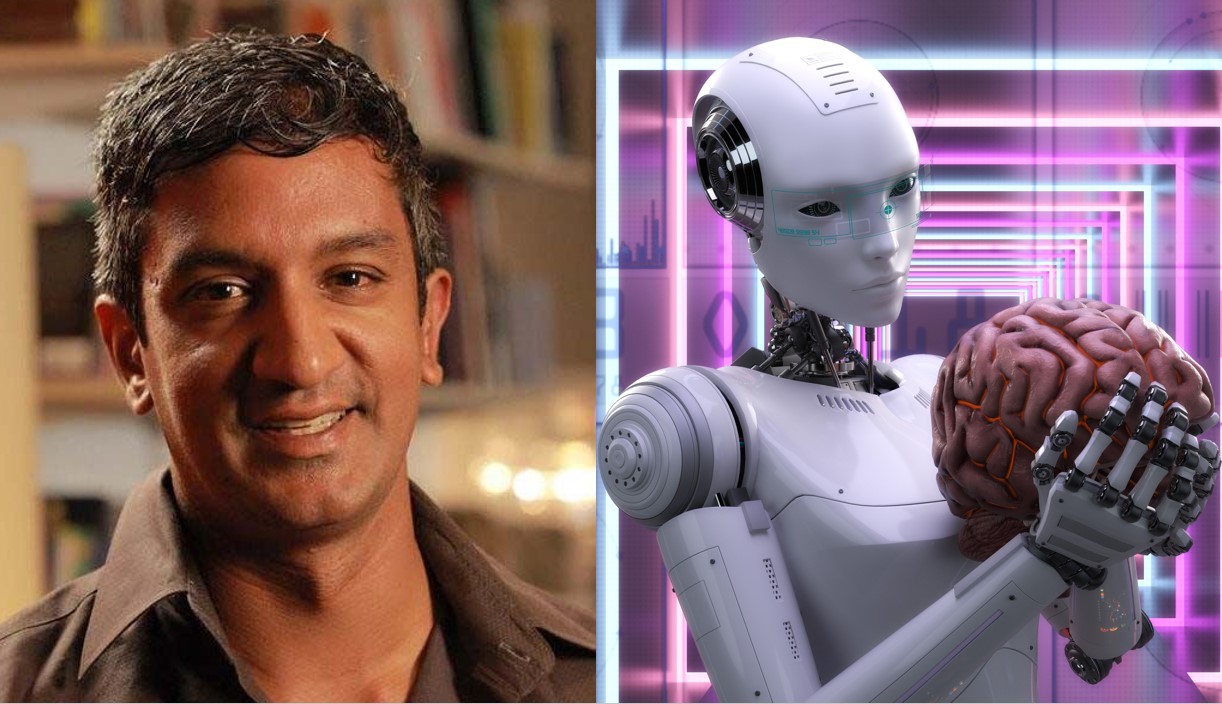

Prof. Dr. Ramesh Srinivasan. Der Informationswissenschaftler, der zunächst in Harvard lehrte, ist Direktor des Digital Cultures Lab an der Universität von Kalifornien und berät Regierungen, Unternehmen und zivilgesellschaftliche Organisationen – unter anderem war er Mitglied des Ausschusses für Innovationspolitik des US-Präsidenten Joe Biden. Er ist zu Gast bei großen US-Fernsehsendern, wie CNN, MSNBC oder CBS, aber auch bei der BBC oder Al Jazeera sowie beim Weltwirtschaftsforum.

Außerdem schreibt er Gastbeiträge für zahlreiche Zeitungen und Zeitschriften, wie Washington Post, New York Times, Financial Times, Economist, National Geographic, The Guardian oder Frankfurter Allgemeine Zeitung. Sein Buch „Beyond the Valley. How Innovators Around the World Are Overcoming Inequality and Creating the Technologies of Tomorrow“ (2021) wurde vom Wirtschaftsmagazin Forbes zu einem der zehn besten Bücher im Bereich Technik gekürt. Der 1976 in Chicago geborene Harvard-, Stanford- und MIT-Absolvent untersucht in seinen Arbeiten die Zusammenhänge von Technologie, Politik, Wirtschaft und Gesellschaft.